MOOC EPALE- Cap 4: Inteligencia Artificial, Robots y RRHH

Autor: Dra. Adrienn Hadady-Lukács, Universidad de Szeged, Facultad de Derecho y Ciencias Políticas, Instituto de Relaciones Laborales y Formación en Seguridad Social

Este es un artículo traducido. El idioma original es el húngaro. La traducción ha sido realizada por encargo del Servicio Nacional de Apoyo a EPALE de España.

Hoy en día, la IA está cada vez más presente en el lugar de trabajo, lo que plantea la cuestión de qué tipo de impacto tiene en los derechos de los empresarios y en el propio trabajo. ¿Cómo transformará la IA los lugares de trabajo del siglo XXI? En este capítulo vamos a analizar la forma en que la gestión algorítmica ha reformado la toma de decisiones de los empresarios. A continuación, abordaremos brevemente el tema de la aplicación de la IA en la "posición" de trabajadores concretos. Por último, el capítulo concluye con un análisis de los retos jurídicos pertinentes, en particular el derecho a la igualdad de trato y el derecho a la protección de los datos personales.

1. Introducción

El uso de la tecnología basada en la IA impregna cada vez más el mundo del trabajo, lo que plantea una serie de cuestiones de Derecho laboral. En el contexto del Derecho laboral, pueden distinguirse dos grandes grupos de cuestiones, relacionadas con la cantidad y la calidad del trabajo. Por un lado, se plantea la cuestión de si la IA y los robots están o no quitando puestos de trabajo a los humanos. Por otro lado, se debate sobre el impacto de la IA en el propio trabajo (el tema mismo de este capítulo). ¿Cómo harán su trabajo los trabajadores, en qué tipo de entorno? [1] Esta es la cuestión que se analiza en este capítulo.

2. Toma de decisiones algorítmica en el lugar de trabajo

Una de las aplicaciones más importantes de la IA en el lugar de trabajo es su uso en el papel de empleador. En Derecho laboral, el empresario tiene ciertos derechos, como controlar, dirigir, instruir y disciplinar, cuyo ejercicio efectivo es inseparable de la toma de decisiones por parte del empresario. Estas decisiones del empresario son diversas e impregnan la vida laboral cotidiana. Por ejemplo, un empresario puede decidir a quién contratar para un determinado puesto, a quién ascender, qué tareas asignar a cada empleado, etc. La novedad que aportan la automatización y la IA es que el empresario puede externalizar algunas o todas estas decisiones a un algoritmo.

La toma de decisiones automatizada significa que un sistema utiliza herramientas tecnológicas para tomar la decisión sin intervención humana.[2] La toma de decisiones automatizada se refiere a la ejecución automática de reglas dadas por humanos (algoritmo basado en reglas) o al uso de sistemas (casi) autónomos basados en IA (algoritmo de aprendizaje)..[3]

Los sistemas automatizados de toma de decisiones se han convertido en parte integrante de la vida cotidiana. Cuando un filtro de spam reenvía un correo electrónico a la carpeta de correo no deseado o cuando aparece un anuncio personalizado en línea en el dispositivo de un usuario.

También es necesario distinguir entre sistemas automatizados de apoyo a la toma de decisiones y sistemas asistidos de apoyo a la toma de decisiones. Mientras que los sistemas automatizados de toma de decisiones toman decisiones de forma autónoma, sin la participación de un responsable humano, los sistemas de apoyo a la toma de decisiones sólo apoyan y complementan la toma de decisiones humana.[4] Sin embargo, un investigación de 2022 ha demostrado que, hoy en día, la toma de decisiones totalmente automática (basada en la IA) no está (¿todavía?) muy extendida. En la práctica, es más típico el uso de la toma de decisiones asistida, es decir, aunque la IA contribuya a la decisión, es el decisor humano quien suele tomar la decisión final.

Otro fenómeno a debatir es el sesgo de automatización. En el caso de los sistemas asistidos de toma de decisiones, los responsables humanos suelen confiar excesivamente en los resultados de la toma de decisiones de la máquina, ya que tienden a considerarla infalible, incluso cuando contradice sus propias creencias o conocimientos.[5] Un ejemplo es cuando alguien sigue ciegamente las instrucciones de un sistema de navegación GPS y se encuentra en un lugar prohibido o peligroso, por ejemplo, cayendo con su coche en un río.

Una forma específica de toma de decisiones automatizada en Derecho laboral es la denominada gestión algorítmica. La gestión algorítmica es "el uso de procedimientos programados por ordenador en una organización para coordinar la mano de obra". [6]; es decir, esencialmente la digitalización y automatización de los poderes conferidos al empresario. En otras palabras, las decisiones que el empresario tiene derecho a tomar se toman mediante un algoritmo. La aplicación de la toma de decisiones automatizada en el lugar de trabajo puede tener varias implicaciones. Puede utilizarse para la contratación y la selección, la medición y evaluación del rendimiento o incluso la planificación de la carrera profesional, entre otras cosas.[7]

En la práctica, es frecuente que los sistemas algorítmicos y los programas informáticos de recursos humanos ayuden a los empresarios a tomar decisiones. Un ejemplo es el software Tengai. El software automatizado Tengai simplifica la contratación guiando a los candidatos a través de una entrevista estructurada y recopilando los datos pertinentes. Esto permite al responsable de RRHH evaluar las competencias profesionales de los candidatos y compararlas entre sí y con los requisitos previstos.

Un ejemplo de control algorítmico del trabajo es el sistema de seguimiento utilizado por Amazon en sus almacenes. Los trabajadores disponían de escáneres que registraban sus periodos de inactividad y la duración de cada fase de trabajo (por ejemplo, la carga en las estanterías). Esto plantea graves problemas de protección de datos. Por ejemplo, la autoridad francesa de protección de datos multó a la Amazon local en 2024 porque su sistema de control no cumplía los requisitos de protección de datos.

Otro ejemplo de reclutamiento y selección modernos es HireVue. La plataforma de contratación de HireVue para toda la empresa es esencialmente un servicio completo de reclutamiento y selección. El software incluye videoentrevistas y encuestas al personal, así como automatización mediante inteligencia artificial. Según el sitio web de la empresa, HireVue hace que la contratación sea más rápida, justa y flexible combinando la entrevista por vídeo con la tecnología de IA.

Un ejemplo de sistema de toma de decisiones totalmente automatizado es el llamado trabajo de plataforma. Según la definición de Eurofound, el trabajo de plataforma es "una forma de empleo que utiliza una plataforma en línea para permitir a organizaciones o individuos acceder a otras organizaciones o individuos para resolver problemas o prestar servicios a cambio de una remuneración". El trabajo de plataforma incluye, entre otros, a los mensajeros de reparto de comida (por ejemplo, Wolt, Foodora) y a los conductores de Uber. El trabajo de plataforma está completamente bajo "control" algorítmico, ya que la asignación de tareas, la nómina, la suspensión de cuentas de usuario, etc. son automáticas, lo que significa que los trabajadores de plataforma no tienen contacto con un ser humano y se comunican con la plataforma a través de una aplicación.

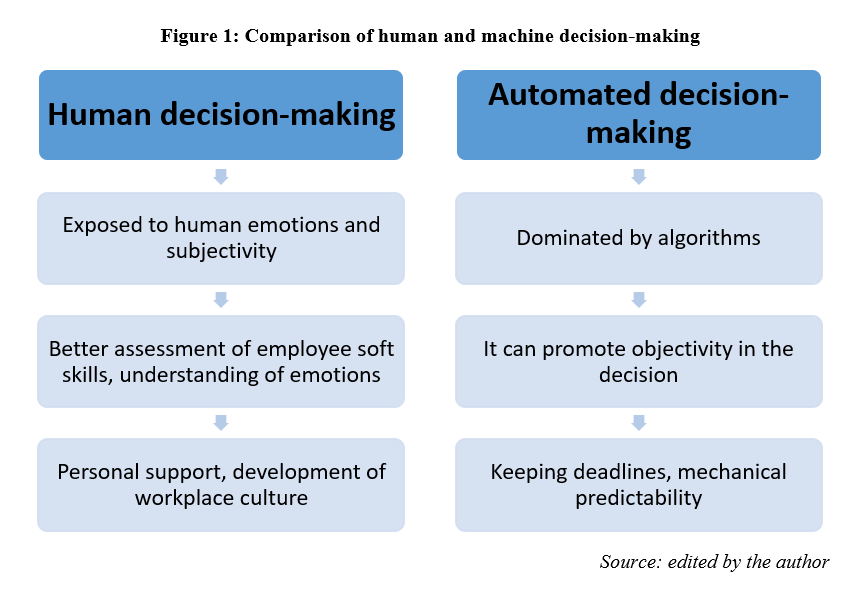

La toma de decisiones algorítmica tiene mucho potencial, ya que estos sistemas pueden ser mejores a la hora de cumplir plazos, resolver problemas y planificar costes, al tiempo que realizan un trabajo más rápido y eficiente. Sin embargo, la toma de decisiones algorítmica no es superior a la humana en todos los aspectos. Los responsables humanos de la toma de decisiones son mejores a la hora de evaluar factores subjetivos y habilidades blandas de los empleados (por ejemplo, capacidad de comunicación o de cooperación), de comprender las emociones, de prestar apoyo personal y de desarrollar la cultura del lugar de trabajo. El uso de sistemas algorítmicos también plantea una serie de retos jurídicos, que se analizarán al final de este capítulo.

The automated systems described above are not always positively received. An interesting example is the ‘No Robot Bosses Act 2023‘, a US bill that would impose requirements on automated decision-making systems in the workplace, including a ban on the exclusive use of automated decision-making systems.

Los sistemas automatizados descritos anteriormente no siempre tienen una acogida positiva. Un ejemplo interesante es la "No Robot Bosses Act 2023", un proyecto de ley estadounidense que impondría requisitos a los sistemas automatizados de toma de decisiones en el lugar de trabajo, incluida la prohibición del uso exclusivo de sistemas automatizados de toma de decisiones.

3. Los "compañeros de trabajo" robóticos y de IA, un entorno laboral cambiante

El creciente uso de la IA conducirá a una "coexistencia" cada vez mayor de trabajadores humanos e IA, transformando no sólo la toma de decisiones de los empresarios, sino también el trabajo y el propio entorno laboral. Por un lado, esto puede manifestarse en forma de máquinas o software impulsados por IA que los trabajadores utilizan para llevar a cabo procesos de trabajo (por ejemplo, software de traducción, fábricas inteligentes).

Un artículo de IBM de 2024 recopiló los casos de uso potencial más importantes de la IA en las empresas, destacando cómo la IA puede ayudar a mejorar la actividad empresarial. Los casos de uso incluyen la mejora de la interacción con el cliente con chatbots y asistentes digitales de IA en tiempo real; el uso de IA generativa para ayudar en la preparación de diversos documentos; el uso de IA para acelerar determinados flujos de trabajo; y la mejora de la ciberseguridad, por citar solo algunos ejemplos.

Por otro lado, puede surgir una mano de obra robotizada (robots industriales o sociales) junto a la mano de obra humana, lo que dará lugar al uso de robots colaborativos, también conocidos como cobots, en el lugar de trabajo. Los robots colaborativos (cobots) están diseñados para trabajar en colaboración con trabajadores humanos en el mismo espacio de trabajo.[8] Los cobots se utilizan en distintos ámbitos, como en el sector sanitario (por ejemplo, RoBear), en fábricas y almacenes, o incluso Pepper, la recepcionista de uso frecuente.

Un artículo en línea publicado en Thomasnet.com propone que las aplicaciones cotidianas de los cobots incluyen robots agrícolas que pueden ayudar a polinizar de forma más eficiente, robots de limpieza autónomos, cobots de restaurante, que conducen a los clientes a sus asientos y les sirven, y robots de venta al por menor que pueden preparar café o cócteles, o incluso asar pollo.

La inteligencia artificial no sólo afectará a los sujetos de la relación laboral, es decir, al empresario y al trabajador, sino también al propio entorno de trabajo. Un ejemplo interesante, aunque algo futurista, es el trabajo en el metaverso. El metaverso puede describirse como un "mundo virtual compartido en 3D en el que todas las actividades pueden realizarse utilizando servicios de realidad aumentada y virtual". [9] El metaverso es inseparable de la digitalización. Puede concebirse como una nueva generación de Internet, en la que los usuarios interactúan en tiempo real a través de sus avatares digitales..[10] Aunque ya existen y se están utilizando las primeras formas de metaverso, es importante señalar que en la actualidad no se dispone de la potencia de hardware y software necesaria para crear la realidad virtual perfecta que los usuarios imaginan como metaverso y que suele representarse en la ciencia ficción.[11]

Las películas Matrix y Ready Player One presentan ejemplos de metaversos "perfectos", que no existen (¿todavía?) en la realidad. Ejemplos de metaversos existentes, aunque relativamente primitivos, son Second Life, un mundo virtual 3D gratuito en el que los usuarios pueden crear, interactuar y chatear con otras personas de todo el mundo mediante voz y texto, y Roblox, un videojuego multijugador en línea y un sistema de desarrollo de juegos. Cabe destacar que Ariana Grande dio un concierto en el metaverso y se han organizado allí ceremonias de graduación universitaria.

Aunque trabajar en un metaverso dista mucho de estar generalizado, el tema ha recibido mucha atención, y ya han empezado a surgir oficinas virtuales.

Algunos ejemplos son la coreana Zigbang' Metaplois y las Horizon Workrooms de Meta (antes Facebook). En 2022, Zigbang trasladó su sede al mundo virtual, lo que permite a los empleados conectarse desde casa e interactuar con los avatares de sus compañeros cuando entran en la oficina virtual. Meta ha creado Horizon Workrooms, un espacio virtual siempre activo donde los empleados pueden trabajar juntos de formas sin precedentes.

4. Ciertas correlaciones entre la IA y el Derecho laboral

El auge de la inteligencia artificial plantea retos para muchos derechos de los trabajadores. Aunque la relación entre la IA y el Derecho (laboral) se tratará con más detalle en un capítulo posterior, es necesario abordar la naturaleza fundamental de los retos jurídicos que se plantean.

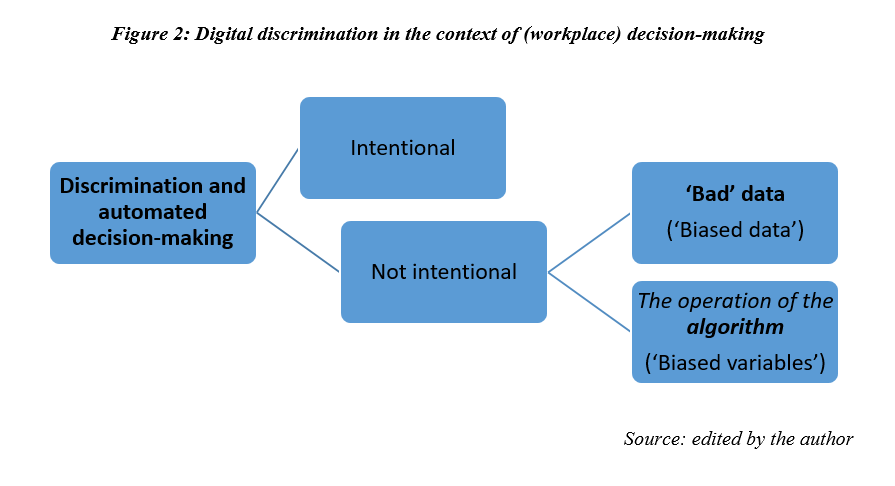

Entre los ámbitos del Derecho especialmente afectados figura el derecho a la igualdad de trato, que reviste especial importancia cuando se utilizan sistemas automatizados de toma de decisiones. La igualdad es uno de los valores fundamentales más importantes de la UE, que prohíbe esencialmente toda discriminación injustificada, en particular la basada en las denominadas características protegidas (por ejemplo, sexo, raza, color, origen étnico o social, etc.).[12] Mientras que los decisores humanos pueden verse influidos inconscientemente por determinados factores, como los estereotipos y prejuicios subyacentes a la discriminación, o incluso por el estado de ánimo y el tiempo, los algoritmos parecen carecer de subjetividad y funcionar de forma mecanicista y predecible. Sin embargo, un análisis más detallado de la cuestión muestra que el factor humano tampoco puede ignorarse en la toma de decisiones algorítmica. Estos sistemas de toma de decisiones se basan en datos, que proceden de bases de datos creadas por personas que viven en una sociedad. Además, los algoritmos están programados por humanos.[13] Estas consideraciones plantean la cuestión de la discriminación digital.

¿Cómo puede un algoritmo discriminar en la selección de trabajadores? Survival of the Best Fit es una simulación en inglés, en la que puedes probar cómo es tomar una decisión como profesional de RRHH y luego confiar en el algoritmo para que tome esa decisión por ti.

Un posible caso de discriminación que se filtra en la toma de decisiones algorítmica es cuando el algoritmo se entrena con datos "malos" que reflejan intrínsecamente la discriminación [14], Es decir, se pide al algoritmo que reproduzca una decisión humana intrínsecamente discriminatoria.

Un ejemplo de ello es el sistema de selección automatizado de Amazon. Amazon hizo un intento de automatizar su proceso de selección en 2014. Al cabo de un año, sin embargo, el proyecto se detuvo porque se descubrió que el sistema discriminaba a las mujeres aspirantes a puestos técnicos. Esto se debió en parte a que la base de datos utilizada para entrenar el algoritmo consistía en currículos de personas ya empleadas con éxito por la empresa, la gran mayoría de las cuales eran hombres. Como era de esperar, el algoritmo llegó a la conclusión de que también debía seleccionar a candidatos masculinos.

En otro caso plausible, el propio algoritmo puede ser la causa de la desventaja.[15] En el caso de los sistemas de decisión autónomos, el fenómeno de la caja negra impide averiguar con absoluta certeza cómo toma el algoritmo su decisión y qué información utiliza para ello.

El término "caja negra" se refiere al fenómeno en el que el funcionamiento de un sistema de IA no es transparente ni comprensible para los humanos, es decir, no es posible explicar exactamente por qué el sistema ha llegado a una decisión concreta. Esto puede deberse a varias razones: el algoritmo, los datos de entrenamiento y el modelo, es decir, los componentes del aprendizaje automático, pueden ser una fuente de opacidad.[16]

Esto puede implicar que, aunque el algoritmo esté programado para ignorar una determinada característica protegida (por ejemplo, el color de la piel), puede sustituirla por otra característica "indirecta" durante el aprendizaje automático..[17]

Por ejemplo, si el sistema de toma de decisiones tiene en cuenta la distancia entre el lugar de trabajo y el de residencia, puede darse el caso de que el lugar de residencia se utilice como sustituto del color de la piel si, por ejemplo, las personas de un determinado color de piel, que es una característica protegida, están sobrerrepresentadas entre las personas que viven en los suburbios.[18]

El funcionamiento de la IA y la gestión algorítmica depende en gran medida del tratamiento de los datos personales, por lo que es especialmente importante asegurarse de que el derecho a la protección de los datos personales se aplica de forma efectiva. La protección de datos personales se refiere esencialmente al conjunto de normas que rigen el procesamiento y el tratamiento de los datos personales relativos al interesado (en este caso, el empleado).[19]

Uno de los retos es la transparencia del tratamiento de datos. Conocida en la legislación de protección de datos como transparencia [artículo 5, apartado 1, letra a), del RGPD], el término significa esencialmente que todo el proceso de tratamiento de datos debe ser transparente para el mundo exterior. Sin embargo, el fenómeno de la caja negra puede poner en entredicho la eficacia de este principio, ya que el observador externo (empresario, empleado o solicitante de empleo) normalmente sólo tendrá conocimiento de la decisión que ha tomado el sistema y de los datos que ha utilizado para tomarla, pero no de la relación causal entre ambos (es decir, por qué y cómo se ha llegado a ese resultado concreto).[20]

El denominado principio de equidad [artículo 5, apartado 1, letra a), del RGPD] implica una actitud moral y ética que va más allá del mero cumplimiento formal de la ley..[21] Por un lado, está estrechamente relacionado con el principio de transparencia y exige que no se induzca a error o engaño a los interesados (en este caso, empleados o solicitantes de empleo) en el contexto del tratamiento de sus datos personales. Por otro lado, por ejemplo en el contexto de la toma de decisiones automatizada, también exige que sea imparcial y cumpla el requisito de igualdad de trato.[22]

Según el principio de minimización de datos [artículo 5, apartado 1, letra c) del RGPD], los datos tratados deben ser adecuados, pertinentes y limitados a lo necesario en relación con los fines para los que se tratan. Una característica fundamental del funcionamiento de la IA es que requiere el acceso al mayor conjunto posible de datos, lo que es especialmente importante en la fase de aprendizaje [23] y para la identificación de contextos nuevos e inesperados.[24] Esto puede entrar en conflicto con el principio de minimización de datos.

En el contexto del uso de cobots pueden surgir importantes cuestiones de salud y seguridad, como accidentes laborales o aumento de la carga de trabajo, que pueden vulnerar el derecho de los trabajadores a trabajar sin poner en peligro su salud y seguridad. Estas cuestiones se tratan en detalle en un capítulo aparte.

El uso de la IA en el lugar de trabajo (ya sea como empleador o como empleado) puede tener muchas ventajas. Puede aumentar la eficacia, la precisión y la rapidez de los procesos, pero no puede (¿todavía?) superar a los empresarios y empleados humanos cuando se tienen en cuenta factores humanos y subjetivos. Sin embargo, el hecho de que algo sea tecnológicamente posible no lo convierte necesariamente en legal. Para aprovechar el potencial de la IA, no debemos olvidar los retos legales asociados a su uso. Por ello, es crucial garantizar que el sistema funcione de forma segura y legal, respetando los derechos fundamentales.

También es importante aclarar que estos retos no los plantea la IA per se (por ejemplo, un empleador humano también puede tomar decisiones discriminatorias o puede hacer funcionar un sistema de control que no respete la privacidad de los datos); se trata de cuestiones que ya se conocen desde hace tiempo, pero que se plantean con diferente intensidad y exigen un mayor escrutinio.

Entre las posibles respuestas a estos retos, este documento se centra en las soluciones que ofrece la legislación. La cuestión se aborda por igual en la legislación vigente que no pretende regular exclusivamente la IA (por ejemplo, las normas sobre la toma de decisiones automatizada incluidas en el Reglamento General de Protección de Datos [RGPD] de la UE) y en la legislación que aborda específicamente la IA (por ejemplo, la Ley de Inteligencia Artificial de la UE). Estas normas se describen detalladamente a continuación.

El uso de la IA en el lugar de trabajo (ya sea como empleador o como empleado) puede aportar muchas ventajas. Puede aumentar la eficacia, la precisión y la rapidez de los procesos, pero no margina (¿todavía?) a los empresarios y empleados humanos cuando se trata de tener en cuenta factores humanos y subjetivos. Pero que algo sea tecnológicamente posible no significa necesariamente que sea legal. Para aprovechar el potencial de la IA, no deben pasarse por alto los retos jurídicos asociados a su uso. Por eso es crucial garantizar que el sistema funcione de forma segura y legal, respetando los derechos fundamentales.

También es importante aclarar que estos retos no son creados intrínsecamente por la IA (por ejemplo, un empleador humano puede tomar decisiones discriminatorias, un empleador humano puede operar un sistema de control que no respete el derecho a la protección de los datos personales), sino que se plantean con diferente intensidad, exigiendo un mayor escrutinio.

Entre las posibles respuestas a estos retos, este documento se centra en las soluciones que ofrece el marco jurídico. Tanto la legislación vigente que regula la IA, aunque no se limita a ella (por ejemplo, el Reglamento General de Protección de Datos de la UE -RGPD-, normas sobre la toma de decisiones automatizada) como la legislación que aborda específicamente la IA (por ejemplo, el Reglamento de la UE sobre Inteligencia Artificial) abordan la cuestión. Estas normas se describen detalladamente a continuación.

Ir al capítulo siguiente

Volver a la página de inicio del MOOC

Lecturas recomendadas

- G. Karácsony Gergely: A mesterséges intelligencia által támogatott munkáltatói döntéshozatal adatvédelmi kérdései. Erdélyi Jogélet (2020) 4. szám, 29-37.o. Elérhető: https://www.jogelet.ro/index.php/eje/article/view/66/54 (Letöltés ideje: 2024. 11. 11.)

- Hajdú József: A robotok munkaerőpiaci hatása. Iurisperitus Kiadó, Szeged, 2020.

- Lukács Adrienn: Digitális diszkrimináció és automatizált döntéshozatal, különös tekintettel a munka világára. Miskolci Jogi Szemle 18. évfolyam (2023) 2. szám, 103-117. o. Elérhető: https://ojs.uni-miskolc.hu/index.php/jogiszemle/article/view/2890/2107 (Letöltés ideje: 2024. 11. 11.)

- Mélypataki Gábor: A munka digitalizálódása a munkajogi alapelvek tükrében. Miskolci Jogi Szemle 15. évfolyam (2020) 3. különszám, 29-37. o. Elérhető: https://www.mjsz.uni-miskolc.hu/files/13828/12_mélypatakigábor_tördelt.pdf (Letöltés ideje: 2024. 11. 11.)

Referencias

[1] Valerio De Stefano: “Negotiating the Algorithm”: Automation, Artificial Intelligence, and Labor Protection. Comparative Labor Law & Policy Journal, 41. évfolyam (2019) 1. szám, 15-16. o.

[2] A 29. cikk szerinti Adatvédelmi Munkacsoport: Iránymutatás az automatizált döntéshozatallal és a profilalkotással kapcsolatban a 2016/679 rendelet alkalmazásához, WP251rev.01, 2017, 8. o.

[3] Algorithm Watch: Automated Decision-Making Systems and Discrimination. Understanding causes, recognizing cases, supporting those affected - A guidebook for anti-discrimination counseling, 2022, 5. o. Elérhető: https://algorithmwatch.org/en/wp-content/uploads/2022/06/AutoCheck-Guidebook_ADM_Discrimination_EN-AlgorithmWatch_June_2022.pdf (Letöltés ideje: 2024. 11. 11.)

[4] Markus Langer – Richard N. Landers: The future of artificial intelligence at work: A review on effects of decision automation and augmentation on workers targeted by algorithms and third-party observers, Computers in Human Behavior (2021) 123. szám, 1. o.

[5] G. Karácsony Gergely: A mesterséges intelligencia által támogatott munkáltatói döntéshozatal adatvédelmi kérdései. Erdélyi Jogélet (2020) 4. szám, 34. o.

[6] International Labour Organization–European Commission: The Algorithmic Management of work and its implications in different contexts. Background paper n°9, 2022, 5. o.

[7] G. Karácsony Gergely: A mesterséges intelligencia által támogatott munkáltatói döntéshozatal adatvédelmi kérdései. Erdélyi Jogélet (2020) 4. szám, 30-32. o.

[8] Valerio De Stefano – Simon Taes: Algorithmic Management and Collective Bargaining. ETUI, Foresight Brief, 2021, 4. o.

[9] Muhammet Damar: Metaverse Shape of Your Life for Future: A bibliometric snapshot, Journal of Metaverse, 2021/1. szám, 1. o.

[10] Hyoung-Yong, Choi: Working in the Metaverse: Does Telework in a Metaverse Office Have the Potential to Reduce Population Pressure in Megacities? Evidence from Young Adults in Seoul, South Korea, Sustainability, 2022/14. évf., 4. p.

[11] Sang-Min Park – Young-Gab Kim: A Metaverse: Taxonomy, Components, Applications, and Open Challenges, IEEE Access, 2022/10. 4210. o.

[12] https://youth.europa.eu/get-involved/your-rights-and-inclusion/right-no…

[13] Ságvári Bence: Diszkrimináció, átláthatóság és ellenőrizhetőség. Bevezetés az algoritmusetikába, Replika, (2017) 3. szám, 66. o.

[14] Ságvári Bence: Diszkrimináció, átláthatóság és ellenőrizhetőség. Bevezetés az algoritmusetikába, Replika, (2017) 3. szám, 66. o.

[15] Ságvári Bence: Diszkrimináció, átláthatóság és ellenőrizhetőség. Bevezetés az algoritmusetikába, Replika, (2017) 3. szám, 66. o.

[16] Üveges István: A feketedoboz jelensége és következményei a mesterséges intelligencia alapú technológiákban. Jogászvilág, 2024. május 6. Elérhető: https://jogaszvilag.hu/a-jovo-jogasza/a-feketedoboz-jelensege-es-kovetkezmenyei-a-mesterseges-intelligencia-alapu-technologiakban/ (Letöltés ideje: 2024. 11. 11.)

[17] Robin Allen – Dee Masters: Artificial Intelligence: the right to protection from discrimination caused by algorithms, machine learning and automated decision-making, Europäische Rechtsakademie (ERA) 2019, 590. o.

[18] Ságvári Bence: Diszkrimináció, átláthatóság és ellenőrizhetőség. Bevezetés az algoritmusetikába, Replika, (2017) 3. szám, 72. o.

[19] Lukács Adrienn: Employees’ Right to Privacy and Right to Data Protection on Social Network Sites: with Special Regard to France and Hungary. Iurisperitus Bt., Szeged, 2021, 60. o.

[20] Kollár Gergő: A mesterséges intelligencia alkalmazásának adatvédelmi aggályai a közigazgatásban. Közigazgatási és Infokommunikációs Jogi PhD Tanulmányok (2022) 1. szám, 14-15. o.

[21] Péterfalvi Attila (szerk.): Magyarázat a GDPR-ról. 2021. május 31. időállapotú, 2021. évi Jogtár-formátumú kiadás, 5.1. fejezet

[22] European Parliamentary Research Service, Scientific Foresight Unit (STOA): The impact of the General Data Protection Regulation (GDPR) on artificial intelligence. (PE 641.530 – June 2020), 44-45. o.

[23] Necz Dániel: A mesterséges intelligencia felhasználásával történő adatkezelések egyes sajátos szempontjai. Acta Humana (2022) 3. szám, 96. o.

[24] European Parliamentary Research Service, Scientific Foresight Unit (STOA): The impact of the General Data Protection Regulation (GDPR) on artificial intelligence. (PE 641.530 – June 2020), 47. o.