Jak mají dospělí lidé rozpoznat obsah generovaný AI?

V době, kdy se deepfakes a syntetický obsah šíří rychle, je stále obtížnější rozlišit mezi realitou a podvodem. Pro bezpečnou orientaci v dnešním mediálním prostředí musí dospělí rozvíjet kritickou mediální gramotnost a schopnost efektivně používat digitální nástroje. Jak ale vlastně rozpoznat AI-generované obrázky, videa a texty?

Charakteristiky deepfaků

Projekt MIT Media Lab "Detect Deepfakes" vyvinul veřejné zdroje, které lidem pomáhají trénovat jejich intuici k odhalování manipulovaných videí. Doporučují sledovat osm znaků: zkreslení obličeje, nerovnoměrnou pleť na tvářích a čele, nepřirozené oči a obočí, nesprávné odrazy v brýlích, zvláštní linie vousů nebo vlasů, náhlé mizení mateřských znamének nebo jizev, abnormální mrkání a nesoulad mezi pohyby rtů a zvukem.

Článek z National Council on Aging (NCOA) poukazuje na to, že deepfake obrázky mají často nepřirozený, lesklý vzhled, zkreslené pozadí a nerovnoměrný tón pleti. Deepfake videa lze odhalit zvláštním mrkáním, chybějícími odrazy nebo zvukem, který neodpovídá pohybům úst.

Uvidíte rozdíl sami

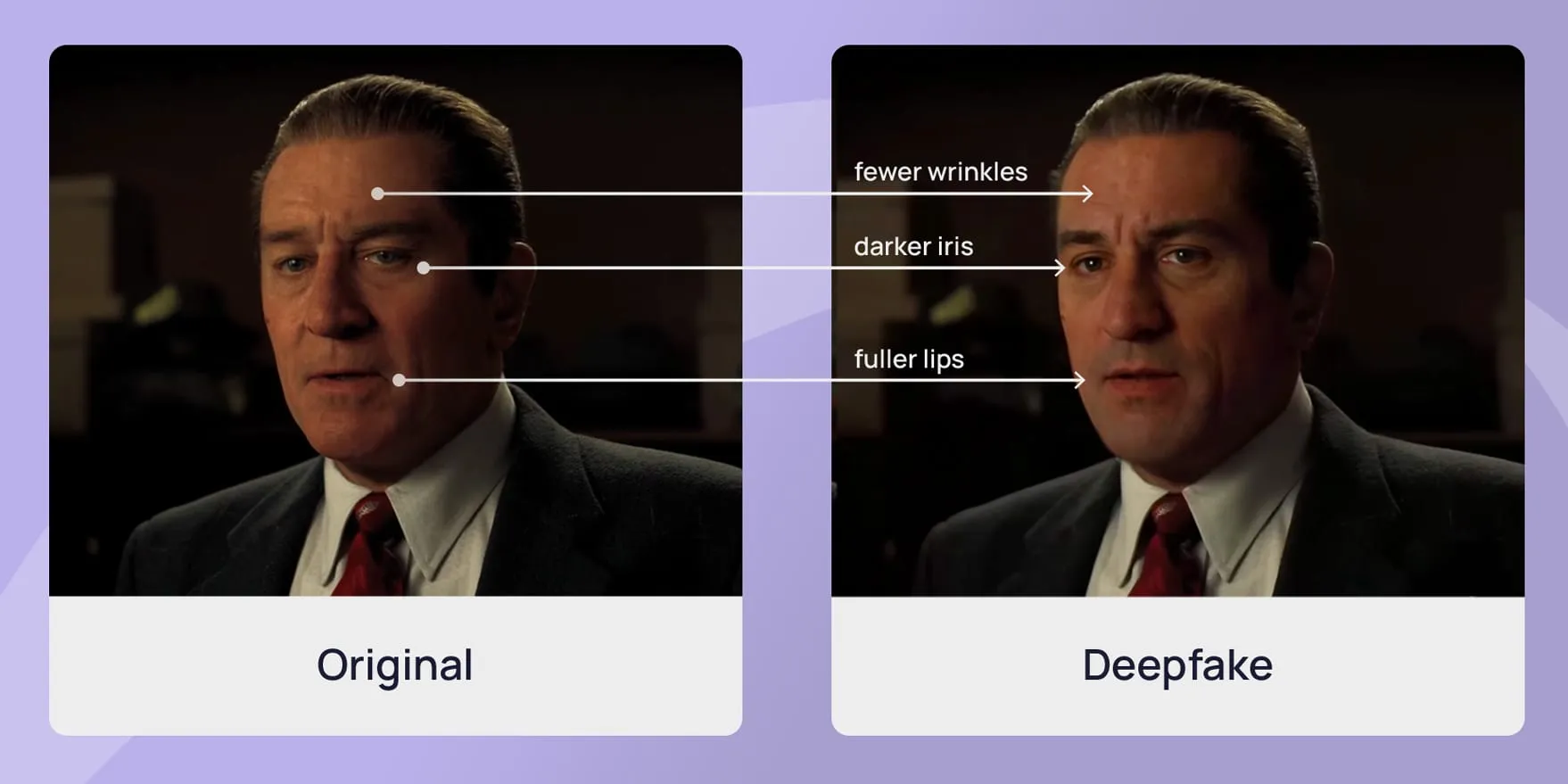

Níže je příklad skutečné fotografie herce Roberta De Nira a deepfake snímku. Věnujte pozornost detailům: textuře pleti, očím, pozadí a symetrii.

Běžné podvody a rizika

Národní rada pro stárnutí (NCOA) varuje, že starší dospělí jsou obzvláště zranitelní vůči podvodům založeným na deepfakes. Ty mohou zahrnovat investiční podvody, podvody s romantikou, politické dezinformace, vydírání nebo falešná doporučení celebrit – často s použitím syntetického zvuku a videa. Takové podvody mohou vést k významným finančním ztrátám, proto je nezbytné naučit se včas rozpoznat manipulace.

Strategie pro rozlišení faktů od obsahu generovaného AI

- Hledejte vizuální a zvukové stopy: Použijte kontrolní seznam a všímejte si nepřirozené textury pleti, nerealistických očí, chybějících stínů nebo detailů, které se mění mezi snímky.

- Zkontrolujte zdroje a kontext: Zjistěte, kdo obsah sdílí a odkud pochází. Vyhledejte primární zdroje a ověřte, zda o stejné informaci informují i renomovaná média.

- Používejte nástroje pro ověřování faktů: Online nástroje jako TinEye a Google Reverse Image Search mohou pomoci vystopovat původní zdroj obrázku. Aplikace jako Deepware Scanner dokážou detekovat deepfake videa. U textu zkuste vyhledat přesné fráze, abyste zjistili, zda je obsah zkopírován.

- Buďte si vědomi emočních spouštěčů: Podvodníci často zneužívají silné emoce, jako je strach, hněv nebo vzrušení, k manipulaci publika. Než budete reagovat nebo sdílet, věnujte chvíli zamyšlení.

- Omezte sdílení osobních informací: NCOA doporučuje minimalizovat množství osobních informací sdílených online, protože to ztěžuje podvodníkům vytváření přesvědčivých duplikátů generovaných AI.

Školení pro dospělé

Školení kritické mediální gramotnosti by mělo zahrnovat praktická cvičení, při nichž účastníci analyzují obrázky, videa a texty, aby identifikovali známky manipulace. Pracemi se skutečnými příklady deepfaků a nácvikem s dostupnými detekčními nástroji si studenti budují povědomí i dovednosti. Školení by mělo zahrnovat také diskuse o tom, jak mohou být algoritmy zneužity v politických kampaních a jak rozpoznat důvěryhodné zdroje. Témata jako etika, soukromí a zodpovědné sdílení by měla být integrována do celého procesu učení.

Závěr

V digitálním věku, kde AI dokáže produkovat vysoce přesvědčivé padělky, je kritická mediální gramotnost životně důležitou dovedností ve vzdělávání dospělých. Naučením se rozpoznávat vizuální a zvukové manipulace, ověřovat zdroje, používat nástroje pro ověřování faktů a uvědomovat si emoční vlivy se dospělí mohou chránit sebe i své komunity před podvody a dezinformacemi.

Odkazy

- MIT Media Lab. Projekt Detect Deepfakes: Osm ukazatelů pro odhalování manipulovaných videí. [media.mit.edu]

- National Council on Aging (NCOA). Článek vysvětlující, co jsou deepfakes, jak se používají při podvodech, jak je identifikovat a jak zůstat chráněn. [ncoa.org]

Přeloženo z angličtiny z https://epale.ec.europa.eu/en/blog/how-can-adults-spot-ai-generated-con….